Googleのインデックス登録にかかる時間はどれくらい?

まず、「何の時間」を指しているのか

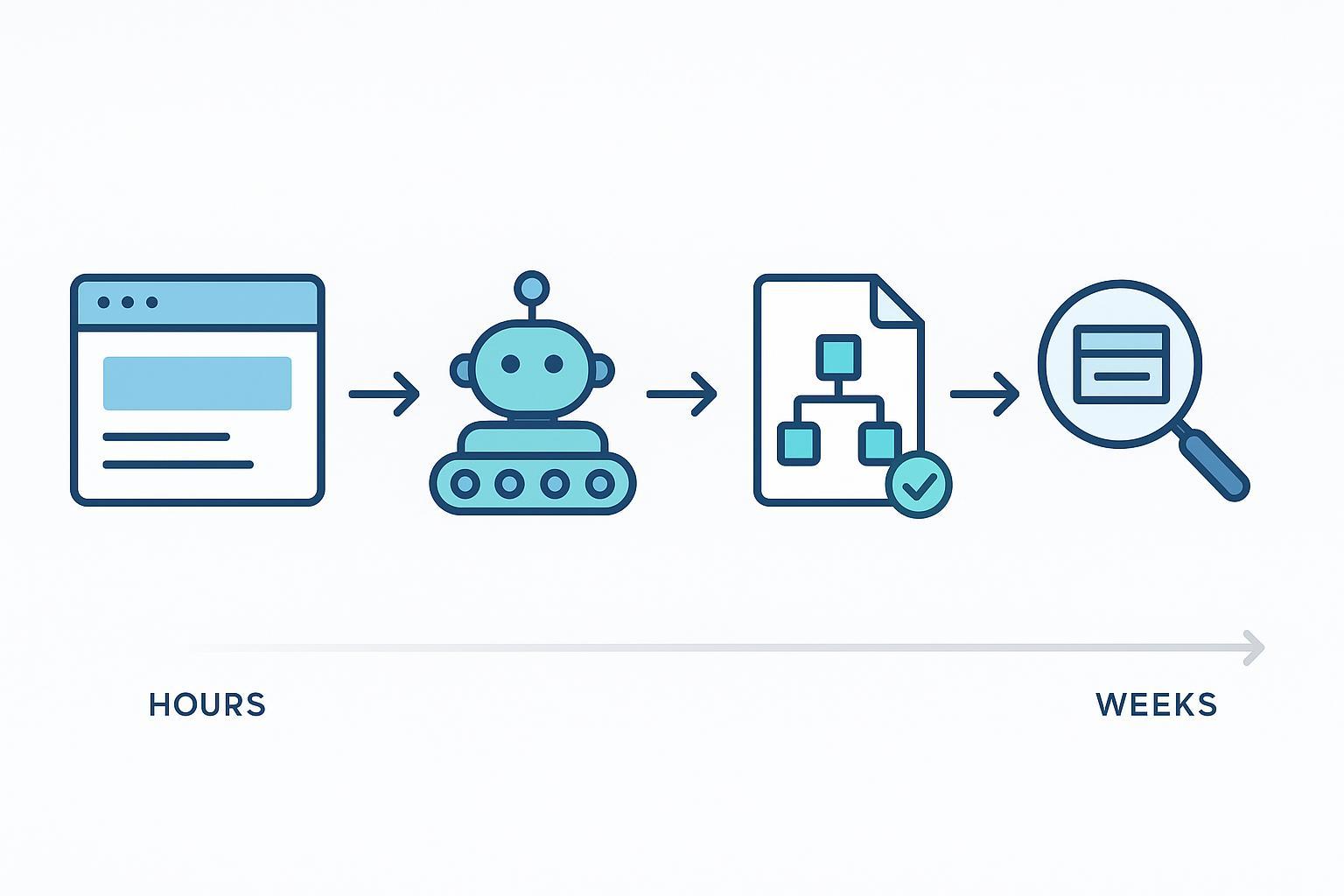

この記事でいう「インデックス登録にかかる時間」は、ウェブページを公開してから、Google がそのページを見つけ(クロール)、内容を整理して検索用のデータベースに追加し(インデックス)、検索結果に表示できる状態になるまでの目安です。重要なのは、Google はこのタイミングを保証していないという前提です。公式ガイドによれば、サイトの変更が検索結果に反映されるまでには「数時間〜数か月かかることがある」と明記されています(2025年時点、詳しくはGoogleのSEOスターターガイドの「変更反映は数時間〜数か月」記述)。

用語の整理:クロール/インデックス/検索表示の違い

- クロール:Google の自動プログラム(クローラー)がページの URL を発見し、アクセスして内容を取得すること。

- インデックス:取得した内容を理解・整理して「検索に使える情報」として登録すること。

- 検索表示(ランキング):ユーザーの検索クエリに応じて、登録済みのページを順位付けして表示すること。

これらは別の工程です。クロールされたからといって、必ずインデックスされるわけではなく、インデックスされても必ず上位表示されるわけではありません。

目安期間:幅がある前提で考える

一般的な体感としては「数時間〜数週間」で検索に反映されるケースが多い一方で、サイトやページの状況によっては数か月かかることもあります。Google は個別 URL の反映時期を約束しない立場であり、確定的な予測はできません(2025年時点。前掲のSEOスターターガイドの記述参照)。

スピードに効く主な要因

- 発見経路の整備:

- XML サイトマップを適切に作成・送信すると、Google が新しい URL を見つけやすくなります。ただし、サイトマップの取得や記載 URL のクロールは「保証されない」と公式に示されています(2025年時点、サイトマップの作成と送信)。

- 重要ページからの内部リンクを丁寧に張り、孤立した URL を作らないこと。

- 外部リンク(他サイトからのリンク)があると発見経路が増えます。

- 技術健全性:

- サーバー応答が速く安定していること(頻繁な 5xx/429 がないこと)。

- robots.txt で重要ページや必要なリソース(CSS/JS 等)を誤って Disallow していないこと(robots.txt の概要)。

- meta robots や HTTP ヘッダーの X-Robots-Tag で noindex を誤設定していないこと(インデックス抑止の仕組み)。

- 重複・正規化の問題が少ないこと(正規 URL の判断が妥当)。

- サイトの評価・運用:

- 継続的な更新、品質の高いコンテンツ、自然なリンク獲得など。

公開直後にやるべき最小手順(再現性重視)

-

重要ページから新規 URL へ内部リンクを追加(カテゴリや関連記事など)。

-

XML サイトマップを最新化し、Search Console に送信して状況を監視(取得エラーがないか、対象 URL が含まれているか)。公式の手順はサイトマップの作成と送信を参照してください。

-

Google Search Console の「URL 検査」機能で公開 URL をテストし、クロール可否・レンダリング・正規 URL 判定を確認。問題がなければ「インデックス登録をリクエスト」を実行します。インデックス登録は保証されず、タイミングも不確実です(2025年時点、クロールとインデックス登録に関するFAQ)。

-

技術チェック:HTTP ステータスが 200 で安定提供されているか、robots.txt と noindex の設定に誤りがないか、レンダリングで重要リソースがブロックされていないか。

よくある誤解の是正

- 「サイトマップを送った=必ずインデックスされる」→ 保証はありません。サイトマップは発見を助けますが、クロールやインデックス自体を約束するものではありません(サイトマップの作成と送信)。

- 「URL 検査でリクエストすれば即時反映する」→ インデックスは保証されません。タイミングは状況依存です(クロールとインデックス登録に関するFAQ)。

- 「robots.txt を Disallow すれば検索に出ない」→ robots.txt はクロール制御です。外部サイトからのリンクなどで URL 自体がインデックスに載る可能性はあります(内容は取得されません)。インデックス抑止は meta robots の noindex 等で行います(robots.txt の概要)。

インデックスが遅い/されないときのチェックリスト

- HTTP ステータス:公開 URL が 200 で返っているか。4xx/5xx/429 の頻発がないか。

- robots.txt:重要ページや CSS/JS を誤ってブロックしていないか。

- noindex:meta robots または X-Robots-Tag に noindex が設定されていないか。

- レンダリング:URL 検査でページが正しく描画されるか。重要リソースがブロックされていないか。

- 正規化:重複コンテンツがあり、正規 URL の指定が不適切になっていないか。

- サイトマップ:対象 URL が含まれ、取得エラーが出ていないか。

大規模サイト運用のポイント(クロールバジェット)

- 重複 URL の抑制、無限生成される URL 空間(ファセットナビゲーション等)の管理。

- 適切な HTTP ステータスの維持、エラー最小化、サーバー応答の改善。

- サイトマップを分割し、サイトマップインデックスで管理(大規模サイト向け)。

次の一手:運用を効率化する

Search Console を使った検証やサイトマップ更新、WordPress への公開など、日々のワークフローを簡素化したい場合は、QuickCreator のようなAIブログプラットフォームを使って作業をまとめる方法もあります。開示: QuickCreator は当社の製品です。コンテンツ作成から公開までの流れを効率化しつつ、XML サイトマップや内部リンクの整備など基本施策を継続できる体制づくりが重要です。

まとめ

- インデックス登録のタイミングは「保証なし・状況依存」。体感では数時間〜数週間が多いが、数か月もあり得ます。

- 発見経路(サイトマップ・内部リンク・外部リンク)と技術健全性(robots/noindex・HTTP・レンダリング)が鍵。

- 公開直後は「内部リンク追加→サイトマップ更新→URL検査で確認→必要ならインデックス登録をリクエスト」の最小手順を回す。

- 遅延時はチェックリストで原因を特定し、継続的な改善を。大規模サイトはクロールバジェットにも配慮しましょう。